更“聰明”的定制機(jī)?人工智能時(shí)代下,助聽科技如何發(fā)展?

2024-09-03 15:05:15

earsound

585

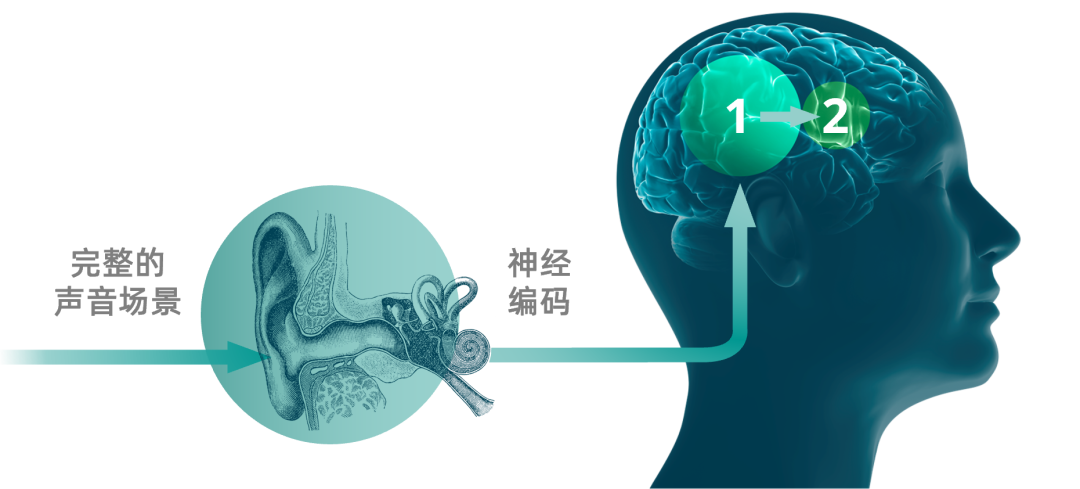

耳朵聽到的只是聲音,大腦理解了才能交流,那么大腦聆聽過程是怎樣的?

奧迪康腦聆聽研究表明,在自然聆聽過程中,大腦首先需要獲取完整的聲音場景,對(duì)周圍環(huán)境實(shí)現(xiàn)初步的分析,隨后大腦的子系統(tǒng)再對(duì)某些感興趣的聲音進(jìn)行關(guān)注和分析。

-01-

簡單或嘈雜環(huán)境

會(huì)給聆聽帶來哪些挑戰(zhàn)?

當(dāng)發(fā)生聽力損失,需要助聽器來補(bǔ)償時(shí),簡單的聲音環(huán)境(如安靜室內(nèi)一對(duì)一交談)并沒有給大腦和助聽器帶來多大挑戰(zhàn),助聽器將聲音進(jìn)行放大,就能讓大腦獲得足夠多的聲音信息,來進(jìn)行關(guān)注和分析。

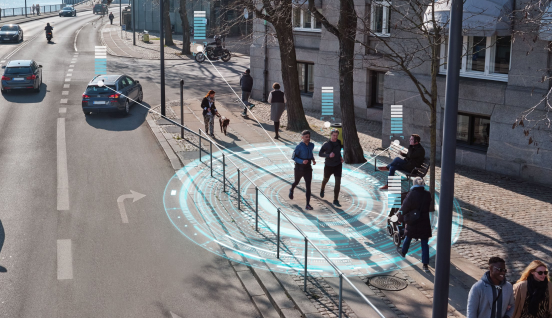

一旦環(huán)境變得嘈雜,比如到了餐廳中、馬路邊,聲音的動(dòng)態(tài)、交雜和不可預(yù)測性為聆聽帶來了巨大的挑戰(zhàn)。普通的放大方式已無法支持聽損患者的大腦對(duì)環(huán)境變化實(shí)現(xiàn)動(dòng)態(tài)感知,或?qū)χ匾穆曇粜盘?hào)實(shí)現(xiàn)準(zhǔn)確判斷。

數(shù)數(shù)看,這個(gè)環(huán)境中有多少種聲音呢?

因此當(dāng)環(huán)境變得復(fù)雜時(shí),大腦的聆聽難度加大,將更依賴于助聽器能否對(duì)環(huán)境中的各種聲音進(jìn)行更加準(zhǔn)確的分析與處理,來為大腦提供高質(zhì)量的聲音信號(hào)。

嘈雜環(huán)境的特點(diǎn)就是聲音復(fù)雜多變,不斷移動(dòng)。助聽器如何更好地區(qū)分出不同的聲音?如何更好地捕捉語音信息?

答案是:只有當(dāng)它從多層面學(xué)習(xí)和了解不同聲音的特征才能實(shí)現(xiàn)。

Own助聽器基于奧迪康當(dāng)前的Polaris平臺(tái)。與傳統(tǒng)助聽器不同,Own是具有深度神經(jīng)網(wǎng)絡(luò)人工智能算法(DNN)的定制式助聽器,該算法模型不僅可以模仿人類大腦的學(xué)習(xí)方式對(duì)各種聲音特征進(jìn)行自主學(xué)習(xí),并且經(jīng)過了大量真實(shí)聲音場景的學(xué)習(xí)和訓(xùn)練,已能夠更聰明地對(duì)各種復(fù)雜環(huán)境的聲音信號(hào)進(jìn)行準(zhǔn)確識(shí)別與處理。

廣泛學(xué)習(xí):Own的深度神經(jīng)網(wǎng)絡(luò)人工智能技術(shù)(DNN),經(jīng)過1200萬聲音場景學(xué)習(xí),能夠識(shí)別海量聲音及其細(xì)節(jié)。

數(shù)據(jù)訓(xùn)練:在開發(fā)過程中,通過大量復(fù)雜的真實(shí)聲音場景,訓(xùn)練其在不同聲音之間創(chuàng)建對(duì)比和平衡的能力,使它在不同環(huán)境下皆能還原完整、清晰、平衡的聲音畫面。

準(zhǔn)確識(shí)別:根據(jù)自主學(xué)習(xí)與開發(fā)訓(xùn)練獲得的成熟經(jīng)驗(yàn)來識(shí)別處理不同聲音,幫助用戶在不同聆聽環(huán)境下更容易區(qū)分聲音和抓住語音。

當(dāng)真實(shí)清晰的聲音畫面

以恰到好處的比例

還原到用戶耳中時(shí)

大腦能更容易地識(shí)別出各種不同的聲音

明白周圍發(fā)生了什么

使得在噪聲中捕捉語音

及提高清晰度變得更簡單

Own為什么

選擇深度神經(jīng)網(wǎng)絡(luò)?

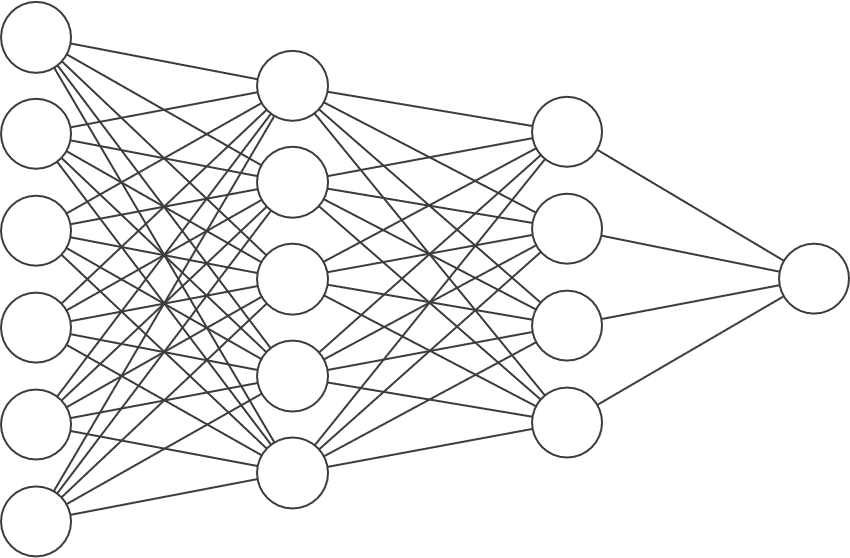

對(duì)如此多種聲音進(jìn)行學(xué)習(xí)與特征提取,是一個(gè)復(fù)雜與龐大的工程,而許多人工智能算法更依賴于人工的干預(yù)、硬性參數(shù)設(shè)定來學(xué)習(xí),用于聲音學(xué)習(xí)容易存在缺漏與片面的情況。深度神經(jīng)網(wǎng)絡(luò) (DNN)不僅可以根據(jù)模型和大量的數(shù)據(jù)訓(xùn)練來進(jìn)行自我學(xué)習(xí),而且非常擅長處理龐大、復(fù)雜的數(shù)據(jù)集。

深度自主探索:DNN是深度學(xué)習(xí)算法的一種,是由3層以上的神經(jīng)網(wǎng)絡(luò)組成,相比于其他人工智能,它可自主從多個(gè)層面掌握不同聲音數(shù)據(jù)的復(fù)雜特征。

精細(xì)特征解析:DNN擅長處理龐大、復(fù)雜的數(shù)據(jù)集,這使它可以完成對(duì)大量聲音特征的提取,并將大部分的聲音特征提取為部分自動(dòng)化。

智能優(yōu)化反饋:DNN接受結(jié)果反饋,只需告知其結(jié)果,便可對(duì)分析過程進(jìn)行改進(jìn),對(duì)聲音數(shù)據(jù)做出有理有據(jù)的判斷。

奧迪康Own的深度神經(jīng)網(wǎng)絡(luò)

不僅僅是標(biāo)準(zhǔn)的人工智能軟件

更是專為實(shí)時(shí)生活場景打造的

現(xiàn)代化助聽器解決方案

奧迪康Own助聽器

為您量身定制

讓現(xiàn)實(shí)更真實(shí)